Crawl Budget Optimizasyonu Rehberi 2026: Googlebot'un Sitenizi Verimli Taramasini Saglayin

Arama motoru optimizasyonunun teknik boyutunda en kritik kavramlardan biri crawl budget yani tarama butcesidir. Ozellikle binlerce sayfaya sahip e-ticaret siteleri, haber portallari ve buyuk olcekli icerik platformlari icin crawl budget yonetimi, organik gorunurlugu dogrudan etkileyen stratejik bir unsurdur. Sayfalariniz ne kadar kaliteli olursa olsun, Googlebot onlari kesfedip indeksleyemiyorsa arama sonuclarinda gorunmeleri mumkun degildir.

Bu rehberde crawl budget kavramini tum detaylariyla ele alacak, tarama butcesini etkileyen faktorleri inceleyecek ve 2026 yilinda uygulamaniz gereken optimizasyon stratejilerini paylasacagiz.

Crawl Budget Nedir?

Crawl budget, Google'in belirli bir zaman diliminde sitenizde taramaya istekli ve muktedir oldugu sayfa sayisini ifade eder. Bu kavram iki temel bilesenden olusur.

Crawl Rate Limit (Tarama Hizi Siniri)

Crawl rate limit, Googlebot'un sunucunuzu asiri yuklemeden yapabilecegi maksimum es zamanli baglanti ve istek sayisini belirler. Google, sunucunuzun yanit surelerine ve performansina bakarak bu siniri dinamik olarak ayarlar. Sunucunuz hizli yanit veriyorsa Google daha fazla sayfa tarar. Sunucunuz yavaslarsa veya 5xx hatalari dondururse tarama hizi otomatik olarak dusurulur.

Crawl Demand (Tarama Talebi)

Crawl demand, Google'in sitenizi ne kadar taramak istedigini ifade eder. Bu talep birden fazla faktore baglidir. Populer ve sik guncellenen sayfalar daha yuksek tarama talebi olusturur. Internette cok sayida baglanti alan sayfalar da Google'in dikkatini daha fazla ceker. Stale yani bayat iceriklerin yeniden taranma ihtiyaci da bu talebi arttirir.

Crawl budget, bu iki bilesenin kesisim noktasidir. Google hem sunucunuzun kapasitesini hem de iceriklerinize olan talebi degerlendirerek sitenize ayirdigi tarama kaynaklarini belirler.

Crawl Budget Neden Onemlidir?

Kucuk ve orta olcekli web siteleri icin crawl budget genellikle bir sorun teskil etmez. Google, birkac yuz sayfadan olusan bir siteyi kolaylikla tarayabilir. Ancak asagidaki durumlarda crawl budget kritik bir oneme sahiptir.

Buyuk olcekli siteler icin sayfalariniz 10 bin, 100 bin veya milyonlarca olabilir. Bir e-ticaret sitesinde her urun varyanti, filtre kombinasyonu ve sayfalama sayfasi ayri bir URL olusturabilir. Google butun bu sayfalari sinirli kaynakla taramak zorundadir.

Sik guncellenen siteler icin haber portallari, blog platformlari ve icerik ajanslari her gun onlarca veya yuzlerce yeni icerik uretir. Bu iceriklerin hizla kesfedilip indekslenmesi gerekir.

Yeni eklenen sayfalar icin ornegin bir e-ticaret sitesine toplu urun yuklediginde bu urenlerin arama sonuclarinda gorulmesi tarama butcesine baglidir. Tarama butcesi verimli kullanilmazsa yeni urunler haftalarca hatta aylarca indekslenmeyebilir.

Teknik sorunlari olan siteler icin crawl budget israfi, Google'in onemli sayfalari taramak yerine degeresiz URL'lerde zaman harcamasina neden olur. Bu durum indeksleme gecikmelerine ve organik trafik kaybina yol acar.

SEOctopus'un Technical SEO Audit modulu, sitenizin taranabilirlik durumunu detayli olarak analiz eder ve crawl budget israfina neden olan sorunlari tespit eder.

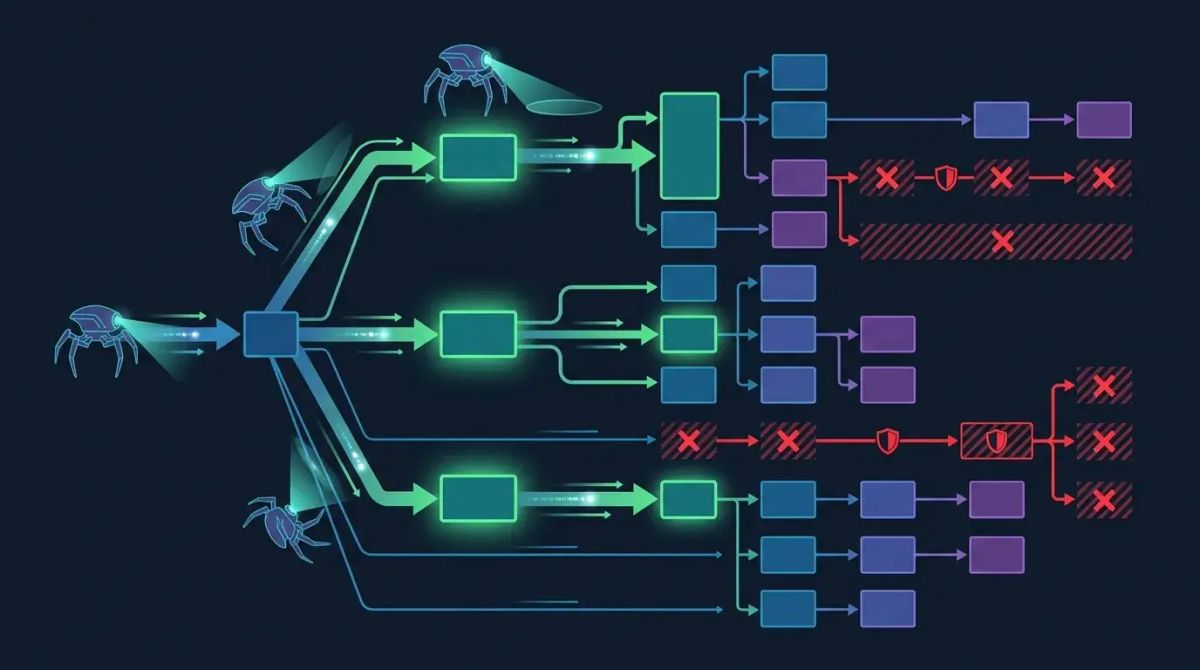

Googlebot Sitenizi Nasil Tarar?

Googlebot'un tarama surecini anlamak, crawl budget optimizasyonunun temelini olusturur. Tarama sureci su asamalardan olusur.

Ilk olarak Googlebot, daha onceden bildigi URL'lerden ve XML sitemap dosyalarindan hareketle bir tarama kuyrugu olusturur. Bu kuyruk, oncelik sirasina gore duzenlenir. Daha once taranmis ve onemli bulunan sayfalar, yeni kesfedilen sayfalara gore daha yuksek oncelik alabilir.

Googlebot bir sayfayi talep ettiginde sunucunuzun yanit kodunu, yanit suresini ve icerigini degerlendirir. Basarili bir yanit aldiktan sonra sayfadaki baglantilari cikartir ve bunlari tarama kuyruguna ekler. Bu surecte robots.txt dosyanizi kontrol ederek hangi alanlara erisebilecegini belirler.

Modern Googlebot, JavaScript icerigi de isleyebilir ancak bu islem ek kaynak gerektirir. JavaScript rendering icin ayri bir kuyruk ve islem hatti bulunur. Bu nedenle JavaScript agirlikli sitelerde tarama ve indeksleme sureci daha uzun surebilir.

Crawl Budget Israfina Neden Olan Faktorler

Tarama butcenizin verimli kullanilmasini engelleyen pek cok faktor vardir. Bunlari tanimak ve ortadan kaldirmak, optimizasyonun ilk adimidir.

Tekrarlayan Icerik ve Duplicate URL'ler

Ayni icerigin birden fazla URL'de erisilebildigi durumlar crawl budget israfinin en yaygin sebeplerindendir. Ornegin ayni urun sayfasina hem www hem de www olmayan versiyonla erisilmesi, HTTP ve HTTPS surumlerinin ayri ayri taranmasi veya trailing slash farkliliklari bu soruna neden olur. Canonical etiketler ve 301 yonlendirmelerle bu durum cozulmelidir.

Parametre URL'leri

E-ticaret sitelerinde filtreleme, siralama ve sayfalama parametreleri binlerce gereksiz URL olusturabilir. Ornegin bir kategori sayfasinda renk, beden, fiyat araligi ve siralama parametreleri birlestiginde yuzlerce kombinasyon ortaya cikar. Bu URL'lerin her biri Googlebot icin ayri bir sayfa gibi gorunur.

Sonsuz Tarama Tuzaklari

Takvim modulleri, oturum tabanli URL'ler ve infinite scroll yapilarinda Googlebot sonsuz bir donguye girebilir. Ornegin bir takvim widgetinda sonraki ay baglantilarini takip ederek binlerce gereksiz URL tarayabilir.

Soft 404 Sayfalari

Sunucu 200 durum kodu dondurdugu halde icerigi olmayan veya anlamli bir icerik sunmayan sayfalar soft 404 olarak adlandirilir. Google bu sayfalari tarar ancak indekslemez. Bu tarama kaynaklarinin bosa harcanmasi demektir. Dogru yaklasim, bu sayfalarin 404 veya 410 durum kodu dondurmesini saglamaktir.

Yonlendirme Zincirleri

Bir URL'den diger bir URL'ye, oradan baska bir URL'ye uzanan yonlendirme zincirleri hem crawl budget harcar hem de link degerinin aktarimini zayiflatir. Her yonlendirme adimi Googlebot icin ayri bir istek demektir. Zincirleri ortadan kaldirip dogrudan hedef URL'ye yonlendirme yapmak onemlidir.

Dusuk Kaliteli ve Ince Icerikli Sayfalar

Cok az icerik barindiran, kullaniciya deger katmayan sayfalar Google tarafindan dusuk kaliteli olarak degerlendirilir. Bu sayfalarin taranmasi, degerli sayfalar icin harcanabilecek kaynaklarin bosa gitmesine yol acar.

SEOctopus'un Crawl Analysis ozelligi, sitenizi Googlebot perspektifinden tarayarak yukaridaki sorunlarin her birini tespit eder ve onceliklendirilmis cozum onerileri sunar.

Robots.txt Optimizasyonu

Robots.txt dosyasi, crawl budget yonetiminin en temel aracidir. Dogru yapilandirilmis bir robots.txt dosyasi, Googlebot'u degerli sayfalara yonlendirirken gereksiz alanlari tarama disinda birakir.

Engellemesi Gereken Alanlar

Yonetim paneli ve admin sayfalarini, dahili arama sonuc sayfalarini, filtre ve siralama parametre kombinasyonlarini, sepet ve odeme adimlarini, kullanici profil sayfalarini ve yazici dostu sayfa versiyonlarini engellemelisiniz.

Dikkat Edilmesi Gerekenler

CSS ve JavaScript dosyalarini engellemeyin. Google'in sayfalarinizi dogru sekilde render edebilmesi icin bu kaynaklara erisimi olmalidir. Engellediginiz alanlarda onemli sayfalar olmadigindan emin olun. Robots.txt'de yaptiginiz degisikliklerin etkisini test edin.

Ornek Robots.txt Yapisi

Etkili bir robots.txt dosyasi su sekilde yapilandirilabilir. User-agent satirinda tum botlar veya spesifik botlar belirtilir. Disallow satirlari ile taranmamasi gereken dizinler ve parametre yapilari engellenir. Allow satirlari ile engellenen dizinler icindeki onemli sayfalar acilir. Son olarak sitemap satirlari ile XML sitemap konumlari bildirilir.

SEOctopus'un robots.txt checker araci, mevcut robots.txt dosyanizi analiz ederek hatali kurallari, eksik tanimlamalari ve iyilestirme firsatlarini raporlar.

XML Sitemap Optimizasyonu

XML sitemap, Google'a sitenizde hangi sayfalarin bulundugunu ve bunlarin ne zaman guncellendigini bildirmenin en etkili yoludur. Crawl budget optimizasyonunda sitemap dosyalari kritik bir rol oynar.

Sitemap En Iyi Uygulamalari

Yalnizca indekslenmesini istediginiz kanonize edilmis sayfalari sitemap'e ekleyin. Noindex etiketli, yonlendirilen veya hata donduren sayfalari sitemap'ten cikarin. Son degisiklik tarihini dogru ve guncel tutun. Google sahte lastmod tarihleri kullanan siteleri cezalandirir. Buyuk sitelerde sitemap dosyalarini kategorilere ayirin ve bir sitemap index dosyasi ile yonetin. Her sitemap dosyasi en fazla 50 bin URL icerebilir ve boyutu sikitirilmamis halde 50 MB'yi gecmemelidir.

Dinamik Sitemap Stratejisi

Buyuk sitelerde statik sitemap dosyalari yerine dinamik olarak olusturulan sitemaplar kullanmak daha etkilidir. Her icerik kategorisi icin ayri sitemap dosyalari olusturabilirsiniz. Ornegin urunler icin products-sitemap.xml, blog yazilar icin blog-sitemap.xml ve kategori sayfalar icin categories-sitemap.xml gibi bolumlemeler yapilabilir.

URL Parametre Yonetimi

URL parametreleri, ozellikle e-ticaret sitelerinde crawl budget israfinin en buyuk kaynaklarindan biridir. Etkili parametre yonetimi icin asagidaki stratejileri uygulamalisiniz.

Filtre ve siralama parametreleri icin canonical etiketi kullanarak tum varyasyonlarin ana sayfaya isaretlenmesini saglayin. Oturum kimlikleri ve izleme parametrelerini URL yapisi yerine cerezler veya JavaScript ile yonetin. Sayfalama parametreleri icin rel next ve rel prev isareti artik Google tarafindan dogrudan desteklenmese de temiz bir baglanti yapisi ve XML sitemap entegrasyonu ile sayfalamali iceriklerin kesfedilmesini kolaylastirin.

Google Search Console'daki URL parametre aracini kullanarak Google'a hangi parametrelerin icerik degistirdigini ve hangilerinin degistirmedigini bildirebilirsiniz. Ancak bu aracin gelecekte kaldirilma ihtimali vardir, bu nedenle teknik cozumler her zaman oncelikli olmalidir.

Dahili Baglanti Yapisi ve Tarama Derinligi

Dahili baglanti yapisi, Googlebot'un sitenizi nasil kesfettigini ve hangi sayfalara oncelik verdigini dogrudan etkiler. Crawl depth yani tarama derinligi, bir sayfanin ana sayfadan kac tikla ulasilabildigi anlamina gelir.

Flat Site Mimarisi

Ideal bir site mimarisinde onemli sayfalar ana sayfadan en fazla uc tik uzaklikta olmalidir. Derin hiyerarsiler Googlebot'un onemli sayfalara ulasmakta zorlanmasina neden olabilir. Breadcrumb navigasyonu, ilgili yazilar bolumleri, kategori sayfalari ve footer linkleri ile site genelinde etkili bir ic baglanti agi kurulmalidir.

Orphan Sayfalarin Tespiti

Hicbir dahili baglantidan erisilemeyen sayfalar orphan yani yetim sayfalar olarak adlandirilir. Bu sayfalar yalnizca sitemap uzerinden kesfedilebilir ve genellikle dusuk tarama onceligi alir. Duzenli site taramalari ile orphan sayfalari tespit ederek bunlari dahili baglanti yapisina dahil etmelisiniz.

Link Equity Dagitimi

Dahili baglantilar araciligiyla sayfalar arasi otorite aktarimi yapilir. Onemli sayfalara daha fazla dahili baglanti yonlendirerek bu sayfalarin hem tarama onceligi hem de siralama gucu arttirilabilir. Ancak asiri sayida baglanti icerikli sayfalar link degini sulandirir. Stratejik ve amacli baglanti yapisi olusturulmalidir.

Sunucu Yanit Suresi ve Taranabilirlik

Sunucu performansi, crawl budget uzerinde dogrudan etkiye sahiptir. Google, yanit suresi yuksek olan sitelerde tarama hizini dusurur. Bu da daha az sayfanin taranmasi demektir.

Hiz Optimizasyonu Icin Oneriler

Sunucu yanit suresi TTFB olarak adlandirilan Time to First Byte degerini 200 milisaniyenin altinda tutmaya calisin. CDN kullanarak statik kaynaklarin dagitimini hizlandirin. Veritabani sorgularini optimize edin ve gereksiz sorgulari onleyin. Sunucu tarafinda onbellekleme mekanizmalari kurun. HTTP2 veya HTTP3 protokollerini kullanarak baglanti verimliligi artirin.

Hosting Altyapisi

Paylasimli hosting planlari buyuk sitelerin tarama taleplerini karsilayamayabilir. Buyuk olcekli siteler icin VPS, dedicated server veya bulut hosting cozumleri tercih edilmelidir. Sunucu kaynaklarinin Googlebot'un yogun tarama donemlerinde bile yeterli olmasi saglanmalidir.

Log Dosyasi Analizi

Server log analizi, crawl budget optimizasyonunun en degerli veri kaynagindan biridir. Log dosyalari Googlebot'un sitenizde hangi sayfalari ne siklikla taradigini, hangi durum kodlariyla karsilastigini ve tarama kaliplarini gosterir.

Log Analizinden Elde Edilen Veriler

Googlebot'un en sik taradigi sayfalarin listesi, taranmayan veya cok nadir taranan sayfalarin tespiti, 404 ve 5xx hatalarinin tarama uzerindeki etkisi, tarama sikligindaki degisimler ve trendler, Googlebot'un takip ettigi yonlendirme zincirleri ve farkli Googlebot turlerinin mobil ve masaustu tarama oranlari gibi degerli bilgiler elde edilir.

Log Analizi Araclari

Screaming Frog Log Analyser, Botify ve Oncrawl gibi araclar log dosyalarini gorsellestirir ve analiz eder. Ancak SEOctopus'un entegre Crawl Analysis modulu, log verilerini site tarama verileriyle birlestirerek butunlesik bir tablo sunar.

Sayfalama ve Crawl Budget

Buyuk icerik arsivleri, urun listeleri ve kategori sayfalarinda sayfalama crawl budget uzerinde onemli bir etki yaratir. Yuzlerce sayfalama sayfasi olan bir kategori, Googlebot'un kaynaklarini tuketebilir.

Sayfalama Optimizasyon Stratejileri

Her sayfalama sayfasina benzersiz ve degerli icerik eklemeye calisin. Sayfalama derinligini sinirlandirin ve kategori alt bolumlemesi ile sayfalama ihtiyacini azaltin. Load more ve infinite scroll yapilarinda Googlebot'un icerigi kesfedebilecegi HTML baglantilarinin bulundugundan emin olun. Sitemap dosyalarinda sayfalama sayfalarini degil, dogrudan icerik sayfalarini listeleyin. Component link yapisi ile ilk sayfa, son sayfa ve ara sayfalara erisimi kolaylastirin.

JavaScript Rendering ve Crawl Budget

JavaScript ile render edilen icerik, crawl budget uzerinde cift katli bir etki yaratir. Googlebot oncelikle HTML'yi tarar ve ardirdan JavaScript'i render etmek icin ayri bir kuyruge gonderir. Bu iki asamali surec ek kaynak ve zaman gerektirir.

JavaScript ile Ilgili Crawl Budget Sorunlari

JavaScript ile yuklenen baglantilar ilk taramada kesfedilemeyebilir. Client-side rendering kullanan sayfalarin indekslenmesi daha uzun surer. JavaScript hatalari sayfanin render edilememesine ve dolayisiyla icerigin indekslenememesine neden olabilir. Asiri buyuk JavaScript paketleri render suresini arttirir ve tarama verimliligi duser.

Cozum Stratejileri

Server-side rendering veya static site generation kullanarak icerigin ilk HTML yanit icinde sunulmasini saglayin. Kritik baglantilarin JavaScript'e bagli olmadan HTML icerisinde yer almasina dikkat edin. Incremental static regeneration ile buyuk sitelerde dinamik icerikler verimli sekilde sunulabilir. JavaScript bundle boyutlarini minimize ederek render suresini kisaltin.

Search Console ile Tarama Istatistiklerini Izleme

Google Search Console, crawl budget performansinizi izlemenin en dogrudan yoludur. Tarama istatistikleri raporu asagidaki verileri sunar.

Toplam tarama istekleri, ortalama yanit suresi, taranan sayfa turleri HTML, resim, CSS ve JavaScript, durum kodu dagilimi, dosya turu dagilimi, Googlebot turu mobil ve masaustu, tarama amaci kesif ve yenileme olarak ayrilir.

Search Console Verileri Nasil Yorumlanir

Tarama isteklerinde ani dusus varsa sunucu sorunlari veya robots.txt degisiklikleri kontrol edilmelidir. Ortalama yanit suresi yuksekse sunucu performansi optimize edilmelidir. 404 hatalarin orani yuksekse kirik baglantilar ve silinen sayfalar gozden gecirilmelidir. Tarama amaci dagiliminda kesif orani dusukse yeni icerikler yeterince baglanti almiyordur.

Buyuk Sitelerde Crawl Budget Yonetimi

100 binin uzerinde sayfaya sahip sitelerde crawl budget yonetimi cok daha stratejik bir yaklasim gerektirir.

Onceliklendirme Stratejisi

Sayfalari gelir potansiyeli ve trafik degerine gore onceliklendirin. En onemli sayfalarin tarama sikligini artirmak icin bu sayfalara daha fazla dahili baglanti yonlendirin. Dusuk degerli sayfalari noindex veya robots.txt ile tarama disinda birakin. Mevsimsel kampanya sayfalarini donem disinda taramadan cikarip kampanya baslamadan once tekrar aktif edin.

Teknik Altyapi Onerileri

Edge caching ile Googlebot'a hizli yanit verin. Dinamik rendering ile bot trafikine ozel optimize edilmis HTML sunun. Hreflang ve alternate etiketlerini dogru yapilandirarak coklu dil ve bolge sayfalarinda gereksiz taramayi onleyin. URL yapisini temiz ve tutarli tutarak parametre karisikliklarini engelleyin.

Periyodik Temizlik

Duzenli olarak site denetimi yaparak indekslenmeyen, trafik almayan ve degeresiz sayfalari tespit edin. Bu sayfalari ya iyilestirin, baska sayfalara yonlendirin veya kaldirin. Bu temizlik islemi crawl budget'in degerli sayfalara yonelmesini saglar.

Noindex, Nofollow ve Disallow Farklari

Bu uc direktif farkli amaclara hizmet eder ve crawl budget uzerinde farkli etkilere sahiptir.

Noindex etiketi sayfanin taranmasini engellemez ancak indekslenmesini onler. Googlebot sayfayi taramaya devam eder bu nedenle crawl budget tuketir. Ancak sayfadaki baglantilar takip edilir.

Nofollow etiketi baglantilardaki link degerinin aktarilmasini engeller. Sayfanin taranmasini veya indekslenmesini etkilemez. Crawl budget uzerinde dogrudan bir etkisi yoktur ancak baglanti yapisi araciliyla dolayli etkisi olabilir.

Disallow komutu robots.txt icinde kullanilir ve Googlebot'un belirtilen alani taramasini engeller. Bu dogrudan crawl budget tasarrufu saglar cunku Googlebot bu sayfalari ziyaret etmez. Ancak dikkat edilmesi gereken nokta, disallow edilen sayfalar baska sitelerden baglanti aliyorsa Google bu sayfalari indeksleyebilir fakat iceriklerini goremez.

En etkili strateji, taranmasini istemediginiz sayfalari disallow ile engellemek ve taranmasini isteyip indekslenmesini istemediginiz sayfalari noindex ile isaretlemektir. Bu iki direktifi bir arada kullanmak ise hatalidir cunku disallow edilen bir sayfadaki noindex etiketi Googlebot tarafindan okunamaz.

Crawl Budget Optimizasyonu Kontrol Listesi

Etkili bir crawl budget optimizasyonu icin asagidaki adimlari sistematik olarak uygulamalisiniz. Robots.txt dosyasini gozden gecirin ve gereksiz alanlari engelleyin. XML sitemap dosyalarini guncellein ve yalnizca indekslenmesi gereken sayfalari ekleyin. Duplicate icerik sorunlarini canonical etiketlerle cozun. Yonlendirme zincirlerini tespit edip dogrudan yonlendirmeye cevirin. Soft 404 sayfalarini gercek 404 veya 410 yanitlarina donusturun. URL parametre sorunlarini cozun. Sunucu yanit surelerini optimize edin. Dahili baglanti yapisini guclendirin. JavaScript rendering sorunlarini giderin. Log dosyalarini duzenli olarak analiz edin.

SEOctopus'un Technical SEO Audit modulu bu kontrol listesindeki her bir maddeyi otomatik olarak denetler ve onceliklendirilmis aksyon onerileri sunar. Crawl Analysis ozelligi ile Googlebot'un sitenizi nasil gorduunu birebir deneyimleyebilirsiniz.

Sikca Sorulan Sorular

Crawl budget kucuk siteler icin onemli midir?

Genellikle 10 binin altinda sayfaya sahip siteler icin crawl budget kritik bir sorun degildir. Google bu olcekteki siteleri kolaylikla tarayabilir. Ancak site teknik sorunlar iceriyorsa ornegin binlerce parametre URL'si veya yonlendirme zinciri varsa kucuk sitelerde bile crawl budget israfi yasanabilir. Her durumda teknik SEO hijyenini korumak faydalidir.

Googlebot'un tarama sikligini nasil artirabilirim?

Google'in tarama sikligini dogrudan kontrol edemezsiniz ancak etkili bazi stratejiler vardir. Sik ve kaliteli icerik guncellemeleri yapin. XML sitemap dosyanizi guncel tutun ve Search Console uzerinden gonderin. Sunucu yanit surelerinizi dusurmeye calisin. Dahili baglanti yapisini guclendirin. Yuksek otoriteli dis sitelerden backlink elde edin. Bu stratejiler Google'in sitenize daha fazla kaynak ayirmasini tesvik eder.

Robots.txt ile engelledigim sayfalar indekste gorunuyor, neden?

Robots.txt yalnizca taramayi engeller, indekslemeyi engellemez. Eger baska siteler o sayfaya baglanti veriyorsa Google sayfayi icerigini gormeden sadece URL ve anchor text bilgisiyle indeksleyebilir. Bir sayfanin indekslenmesini kesin olarak engellemek icin noindex meta etiketi veya X-Robots-Tag HTTP baslik bilgisi kullanmalisiniz. Ancak bu etiketlerin okunabilmesi icin sayfanin taranabilir olmasi gerektigini unutmayin.

Crawl budget optimizasyonu ne siklikla yapilmalidir?

Crawl budget optimizasyonu tek seferlik bir is degildir. Aylik olarak Search Console tarama istatistiklerini incelemelisiniz. Her ceyrekte kapsamli bir site denetimi yaparak yeni olusan sorunlari tespit etmelisiniz. Buyuk site degisikliklerinden sonra tasima, yeniden tasarim veya buyuk icerik guncellemeleri derhal log analizi yaparak Googlebot'un tepkisini izlemelisiniz. SEOctopus ile bu surecler otomatik olarak izlenebilir.

JavaScript siteler icin crawl budget sorunu daha mi buyuk?

Evet, JavaScript agirlikli siteler crawl budget acisindan dezavantajlidir. Googlebot'un JavaScript render etmesi icin ek kaynak ve zaman gerekir. Ayrica JavaScript render kuyrugu ana tarama kuyrugundan ayridir ve daha yavas isler. Bu nedenle server-side rendering veya static site generation kullanmak JavaScript sitelerde crawl budget verimliligi icin onemlidir.

Crawl budget ile indeksleme arasindaki iliski nedir?

Crawl budget dogrudan indekslemeyi belirlemez ancak indekslemenin on kosulunu olusturur. Bir sayfanin indekslenebilmesi icin once taranmasi gerekir. Crawl budget yetersiz oldugunda onemli sayfalar taranmaz ve dolayisiyla indekslenmez. Ancak bir sayfanin taranmis olmasi indeksleneceganlamina gelmez. Google icerigi degerlendirir ve kalite kriterlerini karsilamayan sayfalari indekslemeyebilir. Crawl budget optimizasyonu, Google'un degerli sayfalarinizi oncelikli olarak taramasini saglayarak indeksleme sansini arttirir.

Disallow ve noindex'i birlikte kullanabilir miyim?

Bu iki direktifi ayni sayfa icin birlikte kullanmak mantikli degildir. Robots.txt ile bir sayfanin taranmasini engellerseniz Googlebot o sayfadaki noindex etiketini okuyamaz. Dolayisiyla noindex etkisiz kalir. Taranmasini istemiyorsaniz disallow kullanin. Taranmasini isteyip indekslenmesini istemiyorsaniz noindex kullanin. Ikisini ayni anda kullanmak birbiriyle celisir ve istenmeyen sonuclara yol acabilir.