Crawl Budget Optimierung Leitfaden 2026: So sorgen Sie dafuer, dass Googlebot Ihre Website effizient crawlt

Crawl Budget Optimierung Leitfaden 2026: So sorgen Sie dafuer, dass Googlebot Ihre Website effizient crawlt

Die Crawl-Budget-Optimierung gehoert zu den wichtigsten und gleichzeitig am haeufigsten uebersehenen Aspekten der technischen Suchmaschinenoptimierung. Fuer Websites mit Tausenden oder Millionen von Seiten kann die effiziente Zuweisung von Google-Crawling-Ressourcen den entscheidenden Unterschied fuer die organische Sichtbarkeit ausmachen. Unabhaengig davon, wie hochwertig Ihre Inhalte sind: Wenn Googlebot Ihre Seiten nicht entdecken und indexieren kann, werden sie niemals in den Suchergebnissen erscheinen.

In diesem Leitfaden werden wir das Crawl-Budget-Konzept umfassend untersuchen, alle Einflussfaktoren analysieren und umsetzbare Optimierungsstrategien vorstellen, die Sie 2026 implementieren sollten.

Was ist Crawl Budget?

Crawl Budget bezeichnet die Anzahl der Seiten, die Google bereit und in der Lage ist, innerhalb eines bestimmten Zeitraums auf Ihrer Website zu crawlen. Dieses Konzept besteht aus zwei grundlegenden Komponenten, die zusammen Ihre tatsaechliche Crawl-Zuweisung bestimmen.

Crawl Rate Limit (Crawl-Geschwindigkeitslimit)

Das Crawl Rate Limit definiert die maximale Anzahl gleichzeitiger Verbindungen und Anfragen, die Googlebot an Ihren Server stellen kann, ohne die Leistung zu beeintraechtigen. Google passt dieses Limit dynamisch an die Reaktionsfaehigkeit Ihres Servers an. Wenn Ihr Server schnell und zuverlaessig antwortet, erhoeht Google die Crawl-Rate. Wenn Ihr Server hingegen Fehler zurueckgibt oder langsamer wird, drosselt Google automatisch die Crawl-Geschwindigkeit, um eine Ueberlastung Ihrer Infrastruktur zu vermeiden.

Crawl Demand (Crawl-Nachfrage)

Crawl Demand repraesentiert, wie stark Google Ihre Website crawlen moechte. Diese Nachfrage wird von mehreren Faktoren bestimmt, darunter die Popularitaet Ihrer URLs, die Haeufigkeit von Inhaltsaktualisierungen und das Alter der indexierten Seiten. Seiten, die zahlreiche externe Links erhalten oder erheblichen Suchtraffic generieren, ziehen naturgemaess eine hoehere Crawl-Nachfrage an.

Ihr effektives Crawl Budget ergibt sich aus der Schnittmenge dieser beiden Komponenten. Google beruecksichtigt sowohl die Kapazitaet Ihres Servers als auch den wahrgenommenen Wert des Crawlings Ihrer Inhalte, um zu bestimmen, wie viele Ressourcen Ihrer Website zugewiesen werden.

Warum ist Crawl Budget wichtig?

Fuer kleine und mittelgrosse Websites mit wenigen hundert Seiten stellt das Crawl Budget in der Regel kein Problem dar. Google kann diese Websites problemlos crawlen. Das Crawl Budget wird jedoch in mehreren Szenarien kritisch wichtig.

Grosse Websites mit Zehntausenden bis Millionen von Seiten stehen vor inhärenten Crawl-Budget-Herausforderungen. Eine E-Commerce-Website, auf der jede Produktvariante, Filterkombination und Paginierungsseite eine eindeutige URL erzeugt, kann leicht Hunderttausende von URLs generieren. Google muss all diese mit begrenzten Ressourcen crawlen.

Haeufig aktualisierte Websites wie Nachrichtenportale, Content-Plattformen und Blogs, die taeglich Dutzende oder Hunderte neuer Beitraege veroeffentlichen, benoetigen schnelle Entdeckung und Indexierung. Wenn das Crawl Budget ineffizient ist, kann es Tage oder Wochen dauern, bis neue Inhalte in den Suchergebnissen erscheinen.

Websites mit grossen Aenderungen wie Migrationen, Redesigns oder Massen-Content-Ergaenzungen sind besonders anfaellig fuer Crawl-Budget-Probleme. Wenn Sie Tausende neuer Produktseiten zu einem Online-Shop hinzufuegen, haengt deren Entdeckung und Indexierung vom Crawl Budget ab.

Technisch problematische Websites verschwenden Crawl Budget fuer URLs mit geringem Wert, wodurch Googlebot Zeit auf bedeutungslosen Seiten verbringt, anstatt Ihre wertvollen Inhalte zu crawlen. Dies fuehrt zu Indexierungsverzoegerungen und Verlusten im organischen Traffic.

Das Technical SEO Audit Modul von SEOctopus bietet eine umfassende Analyse der Crawlbarkeit Ihrer Website und identifiziert Probleme, die Crawl Budget verschwenden, mit priorisierten Loesungsvorschlaegen.

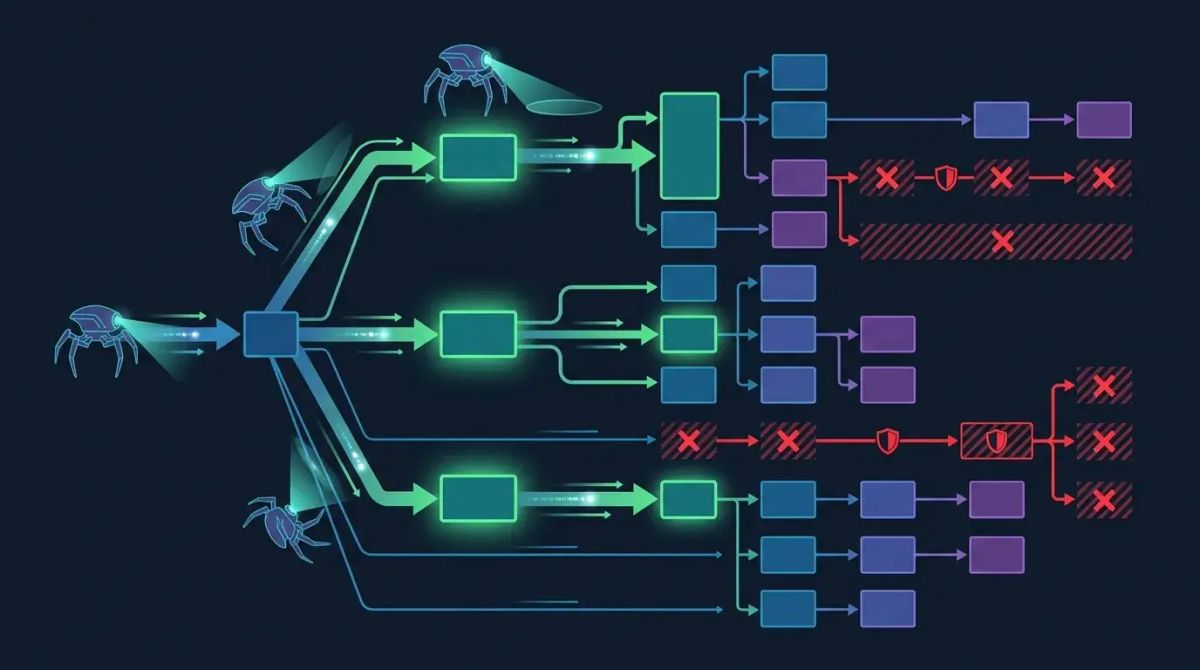

Wie Googlebot Ihre Website crawlt

Das Verstaendnis des Crawling-Prozesses von Googlebot ist grundlegend fuer eine effektive Crawl-Budget-Optimierung. Die Crawling-Pipeline arbeitet in mehreren Stufen.

Zunaechst pflegt Googlebot eine Crawl-Warteschlange, die aus zuvor bekannten URLs, XML-Sitemaps und neu entdeckten Links gespeist wird. Diese Warteschlange wird nach Prioritaet geordnet, wobei wichtige und haeufig aenderbare Seiten eine hoehere Prioritaet erhalten. Wenn Googlebot eine Seite anfordert, bewertet er den Antwortcode des Servers, die Antwortzeit und den Inhalt. Nach einer erfolgreichen Antwort extrahiert er alle Links von der Seite und fuegt qualifizierende URLs zur Crawl-Warteschlange hinzu. Waehrend dieses gesamten Prozesses respektiert Googlebot Ihre robots.txt-Anweisungen.

Der moderne Googlebot kann auch JavaScript-Inhalte verarbeiten. Das JavaScript-Rendering erfordert jedoch eine separate Rendering-Warteschlange und zusaetzliche Rechenressourcen. Diese zweiphasige Crawling- und Rendering-Pipeline bedeutet, dass JavaScript-lastige Websites laengere Zeiten von der Entdeckung bis zur Indexierung erfahren.

Faktoren, die Crawl Budget verschwenden

Die Identifizierung und Beseitigung von Crawl-Budget-Verschwendung ist der erste Schritt zur Optimierung. Mehrere haeufige Probleme verbrauchen Crawling-Ressourcen, ohne einen Mehrwert zu bieten.

Duplizierte Inhalte und doppelte URLs

Wenn derselbe Inhalt ueber mehrere URLs zugaenglich ist, verschwendet Googlebot Ressourcen fuer das Crawlen identischer Seiten. Haeufige Verursacher sind www- versus nicht-www-Varianten, HTTP- versus HTTPS-Versionen, Inkonsistenzen bei abschliessenden Schraegstrichen und Unterschiede bei der Gross-/Kleinschreibung. Die Implementierung korrekter Canonical-Tags und 301-Weiterleitungen behebt diese Probleme und konsolidiert Crawling-Signale.

Parameter-URLs

Auf E-Commerce-Websites koennen Filter-, Sortier- und Paginierungsparameter Tausende unnoetiger URLs erzeugen. Eine einzelne Kategorieseite mit Farb-, Groessen-, Preis- und Sortierparametern kann Hunderte einzigartiger URL-Kombinationen produzieren. Jede davon erscheint fuer Googlebot als separate Seite und verbraucht wertvolle Crawling-Ressourcen fuer im Wesentlichen duplizierte Inhalte.

Endlose Crawl-Fallen

Kalendermodule, sitzungsbasierte URLs und Infinite-Scroll-Implementierungen koennen Googlebot in Endlosschleifen einschliessen. Ein Kalender-Widget mit Links zum naechsten und vorherigen Monat kann Googlebot beispielsweise durch Tausende irrelevanter datumsbasierter URLs fuehren. Ebenso kann Infinite Scroll ohne ordnungsgemaessen HTML-Fallback verhindern, dass Googlebot verlinkte Inhalte entdeckt.

Soft-404-Seiten

Seiten, die einen 200-Statuscode zurueckgeben, aber keinen bedeutungsvollen Inhalt enthalten, werden als Soft 404s klassifiziert. Google crawlt diese Seiten, kann sie jedoch nicht produktiv indexieren. Der korrekte Ansatz besteht darin, sicherzustellen, dass diese Seiten ordnungsgemaesse 404- oder 410-Statuscodes zurueckgeben, um Googlebot zu signalisieren, dass das Crawlen ueberfluessig ist.

Weiterleitungsketten

Weiterleitungsketten, bei denen eine URL zu einer anderen weiterleitet, die wiederum zu einer weiteren weiterleitet, verschwenden Crawl Budget, da jeder Weiterleitungssprung eine separate Anfrage erfordert. Sie verwaessern ausserdem die Link-Equity entlang der Kette. Die Konsolidierung von Weiterleitungsketten zu direkten Einzelsprung-Weiterleitungen verbessert sowohl die Crawl-Effizienz als auch die Uebertragung von Link-Signalen.

Duenne und qualitativ minderwertige Seiten

Seiten mit minimalem Inhalt, die keinen echten Nutzermehrwert bieten, werden von Google als qualitativ minderwertig eingestuft. Das Crawlen dieser Seiten lenkt Ressourcen von Ihren wertvollen Seiten ab. Regelmaessige Content-Audits und die Entfernung oder Verbesserung duenner Seiten geben Crawl Budget fuer wichtige Seiten frei.

Die Crawl Analysis Funktion von SEOctopus crawlt Ihre Website aus der Perspektive von Googlebot, erkennt jedes dieser Probleme und liefert priorisierte Empfehlungen zur Behebung.

robots.txt-Optimierung

Ihre robots.txt-Datei ist das grundlegendste Werkzeug fuer das Crawl-Budget-Management. Eine korrekt konfigurierte robots.txt-Datei lenkt Googlebot zu wertvollen Seiten und blockiert gleichzeitig den Zugang zu Bereichen, die Crawling-Ressourcen verschwenden.

Zu blockierende Bereiche

Sie sollten Admin- und Backoffice-Seiten, interne Suchergebnisseiten, Filter- und Sortierparameterkombinationen, Warenkorb- und Checkout-Schritte, Benutzerprofilseiten und druckerfreundliche Seitenversionen blockieren. Diese Bereiche verbrauchen Crawl Budget, ohne zu Ihrer organischen Suchpraesenz beizutragen.

Wichtige Ueberlegungen

Blockieren Sie keine CSS- und JavaScript-Dateien. Google benoetigt Zugriff auf diese Ressourcen, um Ihre Seiten korrekt zu rendern. Eine Blockierung kann dazu fuehren, dass Google eine defekte Version Ihrer Website sieht, was sowohl das Crawling als auch das Ranking negativ beeinflusst. Stellen Sie stets sicher, dass blockierte Bereiche keine wichtigen Seiten enthalten, die indexiert werden sollten. Testen Sie alle robots.txt-Aenderungen vor der Bereitstellung in der Produktionsumgebung.

Der robots.txt-Checker von SEOctopus analysiert Ihre bestehende robots.txt-Datei, identifiziert Fehlkonfigurationen, fehlende Anweisungen und Optimierungsmoeglichkeiten, die Ihre Crawl-Budget-Nutzung verbessern koennten.

XML-Sitemap-Optimierung

XML-Sitemaps sind Ihr direktester Kommunikationskanal mit Google darueber, welche Seiten auf Ihrer Website existieren und wann sie zuletzt aktualisiert wurden. Sie spielen eine entscheidende Rolle bei der Crawl-Budget-Optimierung, indem sie Googlebot zu Ihren wichtigsten Inhalten leiten.

Best Practices fuer Sitemaps

Nehmen Sie nur kanonisierte, indexierbare Seiten in Ihre Sitemaps auf. Entfernen Sie noindexierte Seiten, weitergeleitete URLs und Fehlerseiten aus den Sitemap-Dateien. Halten Sie die lastmod-Daten genau und aktuell. Google bestraft Websites, die gefaelschte oder aufgeblaehte Aenderungsdaten verwenden, indem es das Vertrauen in Sitemap-Signale reduziert. Segmentieren Sie bei grossen Websites Ihre Sitemaps nach Inhaltstyp und verwalten Sie sie ueber eine Sitemap-Index-Datei. Jede einzelne Sitemap-Datei sollte nicht mehr als 50.000 URLs enthalten und unkomprimiert unter 50 MB bleiben.

Dynamische Sitemap-Strategie

Fuer grosse Websites sind dynamisch generierte Sitemaps effektiver als statische Dateien. Erstellen Sie separate Sitemap-Dateien fuer jede Inhaltskategorie. Verwenden Sie beispielsweise products-sitemap.xml fuer Produktseiten, blog-sitemap.xml fuer Artikel und categories-sitemap.xml fuer Kategorieseiten. Diese Segmentierung hilft Ihnen zu ueberwachen, welche Inhaltstypen effektiv gecrawlt werden, und Bereiche zu identifizieren, die Verbesserung benoetigen.

URL-Parameter-Verwaltung

URL-Parameter, insbesondere auf E-Commerce-Websites, gehoeren zu den groessten Quellen fuer Crawl-Budget-Verschwendung. Ein effektives Parameter-Management erfordert einen mehrgleisigen Ansatz.

Verwenden Sie fuer Filter- und Sortierparameter Canonical-Tags, um alle Variationen auf die Hauptseite zu verweisen. Verwalten Sie Sitzungskennungen und Tracking-Parameter ueber Cookies oder JavaScript statt ueber URL-Parameter. Obwohl rel next und rel prev von Google nicht mehr formal unterstuetzt werden, stellt die Beibehaltung sauberer Linkstrukturen und XML-Sitemap-Integration sicher, dass paginierte Inhalte auffindbar bleiben.

Sie koennen das URL-Parameter-Tool in der Google Search Console verwenden, um Google darueber zu informieren, welche Parameter den Inhalt aendern und welche nicht. Angesichts der Moeglichkeit, dass dieses Tool in Zukunft eingestellt werden koennte, sollten technische Loesungen jedoch immer Vorrang haben.

Interne Linkstruktur und Crawl-Tiefe

Ihre interne Linkarchitektur beeinflusst direkt, wie Googlebot Ihre Website entdeckt und welche Seiten Crawling-Prioritaet erhalten. Die Crawl-Tiefe bezieht sich auf die Anzahl der Klicks, die erforderlich sind, um eine Seite von der Startseite aus zu erreichen.

Flache Website-Architektur

In einer idealen Website-Architektur sollten wichtige Seiten innerhalb von drei Klicks von der Startseite erreichbar sein. Tiefe Hierarchien erschweren es Googlebot, wichtige Seiten zu entdecken und zu priorisieren. Breadcrumb-Navigation, Abschnitte fuer verwandte Inhalte, Kategorieseiten und Footer-Links schaffen ein effektives internes Linknetzwerk, das die Crawl-Tiefe ueber die gesamte Website reduziert.

Erkennung verwaister Seiten

Seiten ohne interne Links, die auf sie verweisen, werden als verwaiste Seiten (Orphan Pages) klassifiziert. Diese Seiten koennen nur ueber Sitemaps entdeckt werden und erhalten typischerweise eine niedrige Crawl-Prioritaet. Regelmaessige Website-Crawls sollten verwaiste Seiten identifizieren, damit sie in die interne Linkstruktur integriert oder bei Nichtbedarf entfernt werden koennen.

Link-Equity-Verteilung

Interne Links uebertragen Autoritaet zwischen Seiten. Indem Sie mehr interne Links auf Ihre wichtigsten Seiten richten, erhoehen Sie sowohl deren Crawl-Prioritaet als auch ihr Ranking-Potenzial. Seiten, die mit uebermässig vielen Links ueberladen sind, verwaessern jedoch die durch jeden einzelnen Link uebertragene Equity. Bauen Sie eine strategische und zielgerichtete interne Linkstruktur auf, anstatt von ueberall auf alles zu verlinken.

Server-Antwortzeit und Crawlbarkeit

Die Serverleistung hat einen direkten Einfluss auf das Crawl Budget. Google reduziert die Crawl-Rate fuer Websites mit hohen Antwortzeiten, was bedeutet, dass innerhalb eines bestimmten Zeitraums weniger Seiten gecrawlt werden.

Empfehlungen zur Geschwindigkeitsoptimierung

Halten Sie Ihre Server-Antwortzeit, bekannt als Time to First Byte oder TTFB, unter 200 Millisekunden. Verwenden Sie ein CDN, um die Bereitstellung statischer Ressourcen zu beschleunigen. Optimieren Sie Datenbankabfragen und eliminieren Sie unnoetige Operationen. Implementieren Sie serverseitige Caching-Mechanismen. Setzen Sie HTTP/2- oder HTTP/3-Protokolle ein, um die Verbindungseffizienz zu verbessern. Jede eingesparte Millisekunde bei der Serverantwortzeit multipliziert sich ueber Tausende gecrawlter Seiten.

Hosting-Infrastruktur

Shared-Hosting-Plaene koennen die Crawl-Anforderungen grosser Websites oft nicht bewaeltigen. Fuer skalierte Websites werden VPS, dedizierte Server oder Cloud-Hosting-Loesungen empfohlen. Stellen Sie sicher, dass Ihre Serverressourcen auch waehrend intensiver Crawling-Perioden von Googlebot ausreichend sind.

Log-Datei-Analyse

Die Server-Log-Analyse liefert die wertvollste Datenquelle fuer die Crawl-Budget-Optimierung. Log-Dateien zeigen genau, welche Seiten Googlebot besucht, wie haeufig er zurueckkehrt, auf welche Statuscodes er trifft und wie seine allgemeinen Crawling-Muster aussehen.

Erkenntnisse aus der Log-Analyse

Die Log-Analyse liefert die Liste der am haeufigsten gecrawlten Seiten, die Identifizierung ungecrawlter oder selten gecrawlter Seiten, die Auswirkungen von 404- und 5xx-Fehlern auf das Crawling-Verhalten, Trends und Veraenderungen in der Crawl-Haeufigkeit ueber die Zeit, von Googlebot verfolgte Weiterleitungsketten und die Verteilung von Mobile- versus Desktop-Googlebot-Crawls.

Tools fuer die Log-Analyse

Tools wie Screaming Frog Log Analyser, Botify und Oncrawl bieten Visualisierung und Analyse von Log-Dateien. Das integrierte Crawl Analysis Modul von SEOctopus kombiniert Log-Daten mit Website-Crawl-Daten, um eine einheitliche Ansicht Ihrer Crawl-Budget-Performance zu praesentieren.

Paginierung und Crawl Budget

In grossen Inhaltsarchiven, Produktlisten und Kategorieseiten kann die Paginierung einen erheblichen Einfluss auf das Crawl Budget haben. Eine Kategorie mit Hunderten von Paginierungsseiten kann erhebliche Crawling-Ressourcen verbrauchen.

Strategien zur Paginierungsoptimierung

Fuegen Sie jeder Paginierungsseite moeglichst einzigartige und wertvolle Inhalte hinzu. Begrenzen Sie die Paginierungstiefe und verwenden Sie Kategorie-Unterteilungen, um die Anzahl der benoetigten paginierten Seiten zu reduzieren. Stellen Sie bei Load-More- und Infinite-Scroll-Implementierungen sicher, dass HTML-Links vorhanden sind, damit Googlebot den Inhalt ohne JavaScript-Ausfuehrung entdecken kann. Listen Sie in Sitemap-Dateien die eigentlichen Inhaltsseiten auf statt der Paginierungsseiten selbst. Verwenden Sie Komponenten-Linkstrukturen, die Zugang zur ersten Seite, letzten Seite und strategischen Zwischenseiten bieten.

JavaScript-Rendering und Crawl Budget

JavaScript-gerenderte Inhalte erzeugen eine doppelte Auswirkung auf das Crawl Budget. Googlebot crawlt zunaechst das rohe HTML und sendet die Seite dann an eine separate Rendering-Warteschlange zur JavaScript-Ausfuehrung. Dieser zweistufige Prozess erfordert zusaetzliche Ressourcen und Zeit.

JavaScript-bezogene Crawl-Budget-Probleme

Ueber JavaScript geladene Links werden moeglicherweise beim ersten Crawl nicht entdeckt. Seiten, die Client-Side Rendering verwenden, brauchen deutlich laenger fuer die Indexierung. JavaScript-Fehler koennen verhindern, dass Seiten ueberhaupt gerendert werden, wodurch ihre Inhalte nie indexiert werden. Uebermaessig grosse JavaScript-Bundles erhoehen die Rendering-Zeit und reduzieren die Crawling-Effizienz fuer die gesamte Website.

Loesungsstrategien

Verwenden Sie Server-Side Rendering oder Static Site Generation, um sicherzustellen, dass Inhalte in der ersten HTML-Antwort vorhanden sind. Stellen Sie sicher, dass kritische Navigationslinks im HTML-Markup ohne JavaScript-Abhaengigkeit existieren. Nutzen Sie Incremental Static Regeneration fuer grosse Websites, um dynamische Inhalte effizient bereitzustellen. Minimieren Sie JavaScript-Bundle-Groessen, um die Rendering-Zeit zu reduzieren und die Gesamtcrawlbarkeit zu verbessern.

Crawl-Statistiken in der Search Console ueberwachen

Die Google Search Console bietet den direktesten Weg, Ihre Crawl-Budget-Performance zu ueberwachen. Der Crawl-Statistik-Bericht liefert umfassende Daten einschliesslich der Gesamtzahl der Crawl-Anfragen, der durchschnittlichen Antwortzeit, der Typen gecrawlter Seiten wie HTML, Bilder, CSS und JavaScript, der Statuscode-Verteilung, der Dateityp-Verteilung, der Googlebot-Typ-Aufschluesselung zwischen Mobil und Desktop sowie des Crawl-Zwecks differenziert nach Entdeckung und Aktualisierung.

Wie man Search-Console-Daten interpretiert

Ein ploetzlicher Rueckgang der Crawl-Anfragen kann auf Serverprobleme oder robots.txt-Aenderungen hinweisen, die untersucht werden muessen. Hohe durchschnittliche Antwortzeiten deuten darauf hin, dass eine Optimierung der Serverleistung erforderlich ist. Ein hoher Anteil von 404-Fehlern weist auf defekte Links oder geloeschte Seiten hin, die behoben werden sollten. Wenn der Anteil der Entdeckungs-Crawls niedrig ist, erhalten neue Inhalte moeglicherweise nicht genuegend interne Links, um die Aufmerksamkeit von Googlebot zu erregen.

Crawl Budget fuer grosse Websites mit ueber 100.000 Seiten

Websites mit mehr als 100.000 Seiten erfordern einen deutlich strategischeren Ansatz fuer das Crawl-Budget-Management als kleinere Websites.

Priorisierungsstrategie

Klassifizieren Sie Seiten nach Umsatzpotenzial und Traffic-Wert. Erhoehen Sie die Crawl-Haeufigkeit fuer Ihre wichtigsten Seiten, indem Sie mehr interne Links auf sie richten. Schliessen Sie Seiten mit geringem Wert vom Crawling aus, indem Sie noindex oder robots.txt-Disallow-Anweisungen verwenden. Verwalten Sie saisonale Kampagnenseiten, indem Sie sie ausserhalb der Saison aus den Crawl-Pfaden entfernen und vor Kampagnenstart wieder aktivieren.

Empfehlungen fuer die technische Infrastruktur

Liefern Sie schnelle Antworten an Googlebot mittels Edge-Caching. Erwaegen Sie dynamisches Rendering, um Bot-Traffic vorab gerendertes, fuer das Crawling optimiertes HTML zu liefern. Konfigurieren Sie hreflang- und Alternate-Tags korrekt, um redundantes Crawling ueber mehrsprachige und multiregionale Seiten zu verhindern. Pflegen Sie eine saubere und konsistente URL-Struktur, um Parameter-Verwirrung und Duplizierung zu vermeiden.

Periodische Bereinigung

Fuehren Sie regelmaessige Website-Audits durch, um Seiten zu identifizieren, die nicht indexiert werden, keinen Traffic generieren und keinen Mehrwert bieten. Verbessern Sie diese Seiten entweder, leiten Sie sie auf relevante Alternativen um oder entfernen Sie sie vollstaendig. Dieser Bereinigungsprozess stellt sicher, dass das Crawl Budget zu Ihren wertvollsten Inhalten fliesst.

Noindex vs. Nofollow vs. Disallow

Diese drei Anweisungen dienen unterschiedlichen Zwecken und haben unterschiedliche Auswirkungen auf das Crawl Budget.

Noindex verhindert nicht das Crawling, sondern die Indexierung. Googlebot crawlt die Seite weiterhin und verbraucht daher Crawl Budget. Links auf der Seite werden jedoch weiterhin verfolgt und Link-Equity wird weitergegeben.

Nofollow verhindert die Uebertragung von Link-Equity ueber Links. Es beeinflusst nicht, ob die Seite selbst gecrawlt oder indexiert wird. Sein direkter Einfluss auf das Crawl Budget ist minimal, obwohl es indirekt die Crawl-Muster durch seine Auswirkung auf den Linkgraph beeinflussen kann.

Disallow in der robots.txt verhindert das Crawling des angegebenen Pfads durch Googlebot vollstaendig. Dies bietet direkte Crawl-Budget-Einsparungen, da Googlebot diese Seiten ueberhaupt nicht besucht. Es ist jedoch wichtig zu beachten, dass Google disallowed Seiten, die externe Links erhalten, moeglicherweise anhand von Anchor-Text und umgebendem Kontext indexiert, ohne ihren tatsaechlichen Inhalt zu sehen.

Die effektivste Strategie besteht darin, disallow fuer Seiten zu verwenden, die ueberhaupt nicht gecrawlt werden sollen, und noindex fuer Seiten, die gecrawlt, aber nicht indexiert werden sollen. Die gleichzeitige Verwendung beider Anweisungen fuer dieselbe Seite ist kontraproduktiv, da Googlebot die noindex-Anweisung nicht lesen kann, wenn eine Seite per disallow blockiert ist.

Haeufig gestellte Fragen

Ist Crawl Budget fuer kleine Websites relevant?

Im Allgemeinen ist Crawl Budget kein kritisches Problem fuer Websites mit weniger als 10.000 Seiten. Google kann Websites dieser Groesse problemlos crawlen. Allerdings kann selbst bei kleinen Websites Crawl-Budget-Verschwendung auftreten, wenn technische Probleme wie Tausende von Parameter-URLs oder lange Weiterleitungsketten vorliegen. Die Pflege einer guten technischen SEO-Hygiene ist unabhaengig von der Website-Groesse immer vorteilhaft.

Wie kann ich die Crawl-Haeufigkeit von Googlebot erhoehen?

Obwohl Sie die Crawl-Haeufigkeit von Google nicht direkt steuern koennen, ermutigen mehrere Strategien Google, Ihrer Website mehr Ressourcen zuzuweisen. Veroeffentlichen Sie regelmaessig hochwertige Inhaltsaktualisierungen. Halten Sie Ihre XML-Sitemap aktuell und reichen Sie sie ueber die Search Console ein. Verbessern Sie Ihre Server-Antwortzeiten. Staerken Sie Ihre interne Linkstruktur. Gewinnen Sie hochautoritaere Backlinks von externen Websites. Diese Signale zeigen Google gemeinsam, dass Ihre Website mehr Crawling-Ressourcen verdient.

Warum erscheinen Seiten, die ich in der robots.txt blockiert habe, immer noch im Index?

Die robots.txt verhindert nur das Crawling, nicht die Indexierung. Wenn andere Websites auf eine blockierte Seite verlinken, kann Google sie allein anhand der URL und der Anchor-Text-Informationen indexieren, ohne ihren tatsaechlichen Inhalt zu sehen. Um die Indexierung definitiv zu verhindern, verwenden Sie ein noindex-Meta-Tag oder einen X-Robots-Tag-HTTP-Header. Beachten Sie jedoch, dass diese Tags nur gelesen werden koennen, wenn die Seite crawlbar bleibt, was eine inhärente Spannung mit der robots.txt-Blockierung erzeugt.

Wie oft sollte ich eine Crawl-Budget-Optimierung durchfuehren?

Die Crawl-Budget-Optimierung ist keine einmalige Aufgabe. Ueberpruefen Sie die Search-Console-Crawl-Statistiken monatlich. Fuehren Sie vierteljährlich umfassende Website-Audits durch, um neu auftretende Probleme zu erkennen. Fuehren Sie nach grossen Website-Aenderungen wie Migrationen, Redesigns oder umfangreichen Content-Updates sofort eine Log-Analyse durch, um die Reaktion von Googlebot zu ueberwachen. SEOctopus automatisiert diese Ueberwachungsprozesse fuer ein kontinuierliches Crawl-Budget-Management.

Ist Crawl Budget ein groesseres Problem fuer JavaScript-Websites?

Ja, JavaScript-lastige Websites stehen vor zusaetzlichen Crawl-Budget-Herausforderungen. Googlebot benoetigt zusaetzliche Ressourcen und Zeit fuer das Rendering von JavaScript-Inhalten. Darueber hinaus arbeitet die JavaScript-Rendering-Warteschlange getrennt von der Haupt-Crawling-Warteschlange und verarbeitet langsamer. Aus diesem Grund ist die Verwendung von Server-Side Rendering oder Static Site Generation besonders wichtig fuer JavaScript-Websites, um die Crawl-Budget-Effizienz aufrechtzuerhalten.

Was ist der Zusammenhang zwischen Crawl Budget und Indexierung?

Das Crawl Budget bestimmt die Indexierung nicht direkt, sondern stellt deren Voraussetzung dar. Eine Seite muss gecrawlt werden, bevor sie indexiert werden kann. Wenn das Crawl Budget unzureichend ist, werden wichtige Seiten moeglicherweise nicht gecrawlt und folglich nicht indexiert. Gecrawlt zu werden garantiert jedoch keine Indexierung. Google bewertet die Inhaltsqualitaet und kann sich entscheiden, Seiten nicht zu indexieren, die seine Qualitaetskriterien nicht erfuellen. Die Crawl-Budget-Optimierung stellt sicher, dass Google das Crawlen Ihrer wertvollen Seiten priorisiert, wodurch die Wahrscheinlichkeit der Indexierung erhoeht und Ihre organische Suchsichtbarkeit verbessert wird.

Kann ich disallow und noindex zusammen auf derselben Seite verwenden?

Die gleichzeitige Verwendung beider Anweisungen auf derselben Seite ist kontraproduktiv und sollte vermieden werden. Wenn Sie eine Seite ueber robots.txt disallow blockieren, kann Googlebot nicht auf die Seite zugreifen, um das noindex-Meta-Tag zu lesen. Das bedeutet, dass die noindex-Anweisung unwirksam wird. Wenn Sie das Crawling verhindern moechten, verwenden Sie disallow. Wenn Sie das Crawling erlauben, aber die Indexierung verhindern moechten, verwenden Sie noindex. Die Kombination beider erzeugt einen Widerspruch, der typischerweise zu unerwuenschten Ergebnissen fuehrt, einschliesslich einer moeglichen Phantom-Indexierung basierend auf externen Signalen.